En bref — L’univers de l’intelligence artificielle regorge de termes techniques qui intimident même les plus aguerris. Du LLM au RAG, en passant par le token et l’inférence, chaque concept joue un rôle crucial dans le fonctionnement des systèmes autonomes. Cet article démystifie le jargon de l’IA pour vous permettre de naviguer avec assurance dans ce paysage en constante évolution, sans culpabilité d’avoir acquiescé sans comprendre.

Brief — 🤖 L’IA crée son propre langage. LLM, tokens, hallucinations, RAG, agents autonomes… ces mots peuplent les conversations technologiques sans que beaucoup comprennent réellement ce qu’ils signifient. 🧠 Comprendre ces termes, c’est accéder au pouvoir. Qu’on soit décideur métier, entrepreneur ou simple curieux, maîtriser le vocabulaire de l’intelligence artificielle ouvre des portes : celle de l’innovation, de la conformité réglementaire, et de décisions plus éclairées. 📊 Le jargon technique cache des réalités opérationnelles. Chaque terme correspond à une capacité concrète, une limitation ou un enjeu éthique. De la structure des réseaux neuronaux à l’optimisation des modèles prédictifs, c’est dans ces détails que se joue l’efficacité réelle des systèmes d’IA. ⚖️ La régulation progresse, mais le langage confond. Avec l’Acte sur l’intelligence artificielle et les cadres français émergents, comprendre le vocabulaire devient aussi une question de conformité légale.

🧠 Les fondations : comment l’IA comprend vraiment

Sommaire de l'article

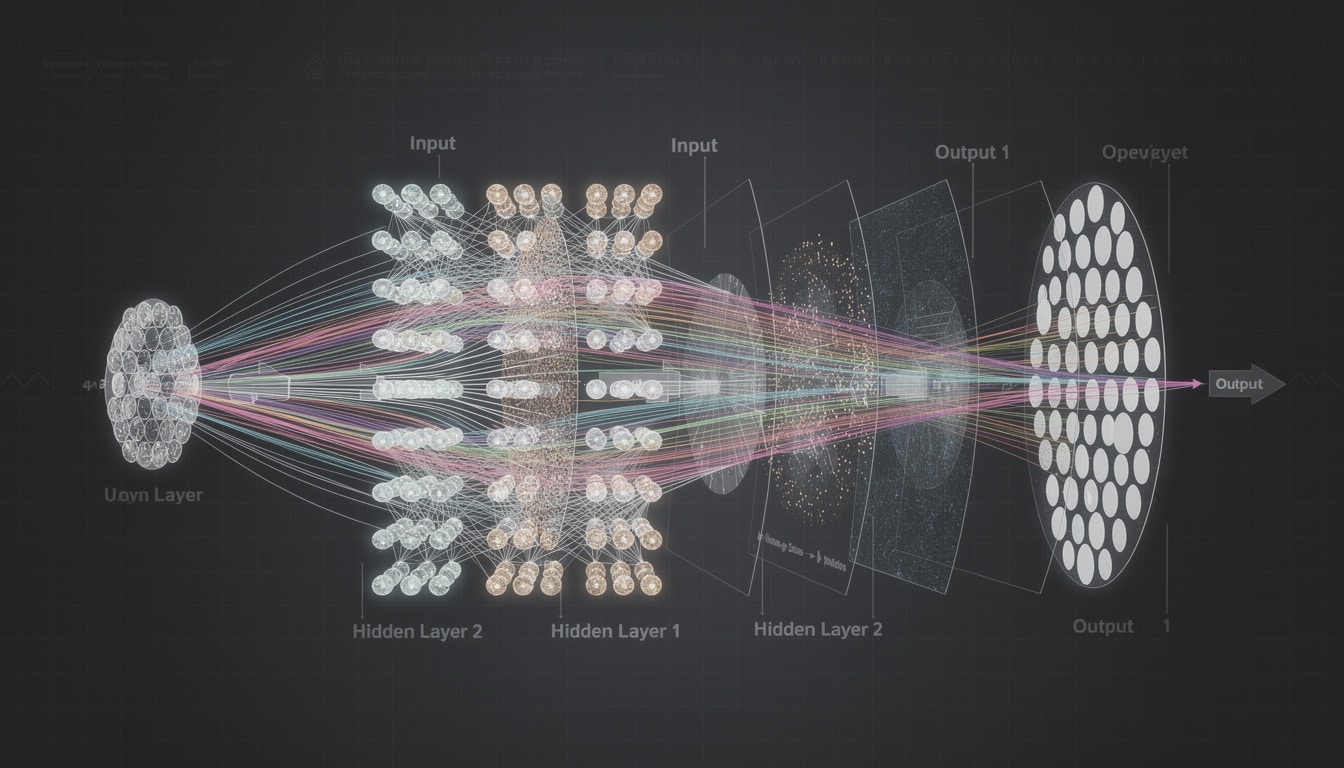

Avant de déchiffrer les termes avancés, il faut saisir les briques élémentaires. Les réseaux neuronaux constituent l’épine dorsale de toute l’architecture moderne de l’IA. Inspirés du fonctionnement du cerveau humain, ils sont composés de couches interconnectées qui traitent les données en passant l’information d’une couche à l’autre, chaque neurone ajustant son contribution au résultat final.

Le deep learning, un sous-ensemble sophistiqué de l’apprentissage automatique, pousse cette logique plus loin en utilisant des réseaux avec plusieurs couches cachées. Cette profondeur permet aux systèmes de capturer des patterns complexes sans que les ingénieurs n’aient à les définir manuellement. Lorsque vous visualisez une image de chat et que l’IA le reconnaît, c’est grâce à des milliers de couches qui ont appris, par répétition et ajustement, quelles caractéristiques définissent un chat.

📈 Les données, carburant des modèles prédictifs

Aucun modèle n’existe sans données. Le training (entraînement) est le processus où l’on expose le système à des millions d’exemples, lui permettant de découvrir les motifs cachés. Contrairement à une simple formule mathématique figée, les modèles d’IA apprennent à adapter leurs outputs en fonction de ce qu’ils voient.

Cette phase d’apprentissage est coûteuse en ressources informatiques — c’est ici qu’interviennent les discussions autour du compute, ce terme qui désigne la puissance de calcul brute : les GPUs, TPUs et autres processeurs spécialisés qui font tourner les algorithmes. Plus le modèle est grand, plus il exige de compute, et plus l’empreinte carbone augmente. C’est un enjeu majeur dans le secteur.

🎯 Les termes clés : du token à l’inférence

Parlons franchement : quand vous tapez une question à ChatGPT, votre texte ne voyage pas tel quel. Il passe d’abord par une étape appelée tokenization. Un token n’est pas un mot entier, mais plutôt un fragment — souvent une portion de mot, parfois plusieurs caractères.

Comprendre cela change la perspective : lorsqu’une API facture par tokens, elle mesure précisément la quantité de travail que le modèle doit accomplir. 100 tokens, c’est environ 75 mots en anglais, mais cela peut varier selon la langue. Cette granularité explique pourquoi certains requêtes semblent disproportionnément coûteuses.

L’inférence, c’est le moment où tout s’accélère : c’est le processus d’exécution réelle du modèle face à une requête utilisateur. Contrairement au training qui peut durer des semaines, l’inférence doit être ultra-rapide. Pour optimiser cette vitesse, les ingénieurs utilisent des techniques comme le memory cache (cache mémoire), qui sauvegarde des calculs répétitifs pour éviter de les recalculer à chaque requête. C’est la différence entre attendre une réponse en 100 millisecondes ou en plusieurs secondes.

⚙️ Les modèles dépassent leurs limites initiales

Tout modèle commence gros et généraliste. Pour le rendre utile dans un domaine spécifique — disons, la rédaction juridique ou l’analyse financière — deux stratégies coexistent.

Le fine-tuning (affinage) consiste à continuer l’entraînement du modèle sur des données très spécialisées. Vous prenez un modèle générique, vous le nourrisez avec mille contrats, et il devient expert en langage juridique. C’est moins cher que d’entraîner un modèle de zéro, mais cela demande quand même des ressources.

Le transfer learning va plus loin : on réutilise des connaissances acquises précédemment pour une tâche nouvelle mais connexe. Un modèle entraîné sur la reconnaissance d’objets peut être rapidement adapté pour identifier des maladies sur des images médicales. C’est une forme d’économie d’échelle dans l’innovation IA.

💡 Les agents et l’automatisation autonome

Depuis 2023-2024, le terme AI agent a explosé dans le vocabulaire tech. Contrairement à un chatbot passif qui attend votre question, un agent autonome prend des décisions et exécute des actions — il peut réserver un vol, écrire du code, analyser des documents, tout en enchaînant les étapes sans intervention humaine.

Pour qu’un agent fonctionne, plusieurs composantes doivent converger : les API endpoints (ces « boutons numériques » que les systèmes externes exposent), une capacité de raisonnement, et une mémoire de contexte. Lorsqu’un agent appelle une API, il demande au système externe d’accomplir une tâche spécifique — acheter, créer, modifier.

Les coding agents illustrent cette capacité de façon saisissante : ils peuvent écrire du code, le tester, identifier des bugs et les corriger, tout en naviguant dans une base de code entière. C’est une forme d’automatisation qui commence à transformer profondément les métiers techniques.

🔗 La chaîne de raisonnement, secret des réponses justes

Vous vous demandez pourquoi certaines IA donnent des réponses évidentes tandis que d’autres font des erreurs logiques ? La réponse réside dans le chain-of-thought (chaîne de pensée). Cette technique oblige le modèle à décomposer un problème en étapes intermédiaires plutôt que de sauter directement à la réponse.

Imaginez une question mathématique : « Si 40 animaux ont ensemble 120 pattes, et qu’il n’y a que des poules (2 pattes) et des vaches (4 pattes), combien y a-t-il de chaque ? » Sans chaîne de pensée, un LLM pourrait deviner. Avec elle, il écrit l’équation, la résout étape par étape, et arrive à 20 poules et 20 vaches. La différence peut être dramatique pour des tâches complexes.

C’est particulièrement crucial pour les systèmes agentiques qui exigent rigueur logique, où une erreur de raisonnement peut avoir des conséquences concrètes.

🎨 Créer plutôt que prédire : la génération et la diffusion

Jusqu’à présent, nous avons parlé de systèmes qui « lisent » et répondent. Mais comment les IA créent-elles ? Deux approches dominent : les GANs et la diffusion.

Un GAN (Generative Adversarial Network) fonctionne comme un duel entre deux réseaux : l’un génère du contenu (images, sons), l’autre tente de le discerner du vrai. Cette compétition perpétuelle force la qualité à monter progressivement. Les GANs sont redoutables pour produire du contenu visuellement réaliste, mais moins flexibles que les approches basées sur la diffusion.

La diffusion, technologie derrière Stable Diffusion et DALL-E, fonctionne différemment : elle commence avec du bruit pur et apprend progressivement à le « nettoyer » pour produire une image, une musique ou un texte. C’est contre-intuitif, mais extraordinairement efficace. Là où un GAN « construit », la diffusion « restaure ».

⚠️ Les hallucinations, le talon d’Achille de la génération

Voici une réalité inconfortable : les modèles génératifs hallucinent. Ce terme de l’industrie désigne simplement l’invention pur et simple de faits, de citations ou de chiffres. Un LLM peut vous citer une étude qui n’existe pas, inventer une déclaration d’un politicien, ou décrire un processus scientifique totalement faux.

D’où vient ce phénomène ? Principalement de lacunes dans les données d’entraînement. Si le modèle n’a jamais vu d’informations sur un sujet précis, il ne « sait » pas qu’il ne sait pas — il hallucine plutôt que de dire « je ne sais pas ». C’est pourquoi les systèmes spécialisés, ceux qui sont fine-tunés sur des données vérifiées et fermées, hallucinent moins.

Une stratégie émerge pour combattre cela : le RAG (Retrieval-Augmented Generation). Au lieu de laisser le modèle inventer, on lui fournit des documents pertinents avant sa génération. Ainsi, il « cite » plutôt qu’il n’« invente ».

🔄 L’optimisation perpétuelle : RLHF et validation loss

Comment transforme-t-on un modèle brut et parfois maladroit en assistant utile et sûr ? Grâce au reinforcement learning from human feedback (RLHF). Des humains évaluent les réponses du modèle (bonnes, mauvaises, dangereuses), créant un système de récompense mathématique. Le modèle apprend alors à maximiser ces récompenses.

Parallèlement, les chercheurs observent la validation loss — un indicateur numérique qui révèle si le modèle apprend vraiment ou s’il mémorise bêtement ses données. Une validation loss qui augmente signale l’« overfitting », c’est-à-dire que le modèle devient un perroquet de ses données d’entraînement plutôt qu’un généralisateur intelligent.

Surveillez ces deux paramètres : ce sont les instruments de bord de toute équipe sérieuse entraînant des modèles. Sans eux, impossible de savoir si vous construisez un vrai système d’IA ou juste une illusion statistique.

📊 L’infrastructure derrière la magie

Parlons de ce qui rend tout cela possible à grande échelle : la parallelization (parallélisation). Les calculs de l’IA ne se font pas séquentiellement — un calcul après l’autre. Ils se font massivement en parallèle sur des milliers de processeurs.

Les GPUs (Graphics Processing Units) dominent ce secteur. Initialement conçues pour les jeux vidéo, elles se sont révélées parfaites pour les calculs matriciels massivement parallèles que les réseaux neuronaux exigent. C’est pourquoi Nvidia est devenue l’une des plus grandes entreprises du monde.

Mais voilà le revers : la demande en compute est insatiable, et cela crée une pénurie grotesque de RAM et de puces. Le terme « RAMageddon » capture l’absurdité actuelle : les géants de l’IA achètent tellement de mémoire pour leurs data centers que les consoles de jeux et les smartphones manquent de puces. C’est un symptôme de l’hyperconcentration du secteur.

🚀 Le throughput, obsession silencieuse des infrastructures

Les ingénieurs infrastructure ne parlent pas de vitesse abstraite, mais de token throughput — combien de tokens peut-on traiter par seconde à travers tout le système. C’est la différence entre servir 100 utilisateurs simultanément ou 10,000.

Cela explique aussi pourquoi les entreprises investissent des milliards dans des clusters spécialisés : maximiser le throughput réduit la latence et permet d’amortir le coût par utilisateur. Un token non utilisé est du compute gaspillé — et avec les prix actuels, c’est une hémorragie financière.

🤝 L’optimisation intelligente : distillation et réduction

Déployer un modèle énorme en production est impratique. Alors, comment procéder ? La distillation est une technique où un grand modèle « enseignant » transfère ses connaissances à un modèle « étudiant » plus petit. L’étudiant est entraîné non seulement sur les données brutes, mais aussi sur les prédictions du professeur.

Résultat : un modèle 10 fois plus petit qui capture 95 % de la performance du grand. C’est crucial pour déployer l’IA sur des téléphones, des objets connectés ou des serveurs edge. OpenAI a probablement utilisé cette technique pour créer GPT-4 Turbo, une version plus rapide du colossal GPT-4.

Cette approche illustre une tendance plus large : l’efficacité bat la puissance brute. Des modèles spécialisés, légers et justement optimisés surpassent les géants paresseux. C’est une leçon que l’industrie est en train d’apprendre douloureusement.

⚖️ Réguler l’IA : quand le vocabulaire devient légal

L’Europe a tranché : l’AI Act encadre désormais l’IA de manière stricte. Mais cette régulation crée une couche supplémentaire de jargon — distinctions entre IA généraliste, IA à risque élevé, IA interdite, etc. Le glossaire de l’AI Act définit les termes avec rigueur légale, pas simplement technique.

Pour les entreprises, comprendre cette distinction est devenue obligatoire. Un AGI (Artificial General Intelligence) — un système aussi capable qu’un humain moyen sur la plupart des tâches — reste largement théorique, mais des réglementations anticipent déjà son arrivée. La CNIL propose un guide complet 2025 pour naviguer ces enjeux avec les obligations de conformité RGPD.

🔍 Clarifier les poids (weights) : au cœur de la prédiction

Revenons aux fondamentaux mathématiques : les weights (poids) sont les paramètres numériques qui décident quelles caractéristiques du données importent vraiment. Un modèle de prédiction de prix immobilier aura des poids différents pour « nombre de chambres » et « couleur de la porte ».

Ces poids ne sont pas choisis arbitrairement. Ils sont appris progressivement durant le training, ajustés à chaque itération jusqu’à ce que les prédictions correspondent à la réalité observée. Comprendre comment les poids se distribuent, c’est comprendre ce que le modèle « croit » être important — et parfois, c’est révélateur de biais.

🎓 Des termes émergents qui redéfinissent l’IA

Le secteur évolue à la vitesse du bruit. Open source versus closed source structure désormais le débat éthique et compétitif. Meta a ouvert Llama, permettant à des milliers de développeurs d’expérimenter librement. OpenAI garde GPT sous clé. Cette friction crée deux univers parallèles : celui de l’innovation collaborative et celui du contrôle propriétaire.

Avec cela vient l’enjeu des agents autonomes qui, comme expliqué précédemment, changent profondément la nature du travail intellectuel. Le cadre éthique et opérationnel des agents IA devient une priorité urgente pour les organisations qui les déploient.

Enfin, les termes comme AGI restent flous — experts et PDG en donnent des définitions différentes. Sam Altman décrit l’AGI comme « un coéquipier humain de niveau médian ». DeepMind insiste sur la capacité cognitive générale. Cette ambiguïté n’est pas une faiblesse : c’est le signe d’un domaine qui n’a pas encore trouvé ses limites conceptuelles.

La démystification du vocabulaire de l’IA n’est pas une fin en soi — c’est un point de départ. Chaque terme cache une décision d’ingénierie, une limitation technique, un choix éthique. En comprenant le langage, vous accédez à la capacité de questionner, d’auditer et d’innover responsablement. C’est la vraie valeur : pas de culpabilité d’acquiescer sans comprendre, mais du pouvoir d’action informée.

Author Profile

-

🚀 Expert en systèmes autonomes et architectures d'Agents IA

Passionné par l'ingénierie logicielle depuis plus de 12 ans, j'ai fait de l'intégration de solutions cognitives mon terrain de jeu privilégié. Observateur attentif de la révolution technologique actuelle, je consacre aujourd'hui mon expertise à accompagner les entreprises dans une transition cruciale : passer du "Chatbot passif" à l'Agent autonome, capable de raisonner et d'exécuter des tâches complexes en toute indépendance.

🎓 Mon Parcours & Certifications

Mon approche repose sur un socle académique solide et une mise à jour constante de mes compétences :

- Ingénieur en Informatique : Diplômé avec une spécialisation en Intelligence Artificielle, j'ai acquis les bases théoriques indispensables à la compréhension des réseaux de neurones.

- Certifications Spécialisées : Certifié en Deep Learning (DeepLearning.AI) et en Architecture Cloud (AWS), je maîtrise les infrastructures nécessaires au déploiement de l'IA à grande échelle.

- Formation Continue : Je mène une veille active et technique sur les frameworks qui redéfinissent notre métier, tels que LangChain, AutoGPT et CrewAI.

🛠 Expérience de Terrain

Avant de me lancer dans l'aventure Agentlink.org, j'ai piloté le déploiement de modèles de langage (LLM) pour des acteurs exigeants de la FinTech et de la Supply Chain. Mon expertise ne s'arrête pas au code (Python, bases de données vectorielles) ; elle englobe une vision stratégique pour transformer ces innovations en leviers de croissance concrets pour les métiers.

Latest entries

Actus Intelligence Artificielle - Agent IA30 mai 2026Quand l’intelligence artificielle, censée protéger le crédit bancaire, devient un facteur de vulnérabilité

Actus Intelligence Artificielle - Agent IA30 mai 2026Quand l’intelligence artificielle, censée protéger le crédit bancaire, devient un facteur de vulnérabilité Actus Intelligence Artificielle - Agent IA30 mai 2026Les développeurs refusent de coder sans IA — un pari risqué qui pourrait se retourner contre eux

Actus Intelligence Artificielle - Agent IA30 mai 2026Les développeurs refusent de coder sans IA — un pari risqué qui pourrait se retourner contre eux Actus Intelligence Artificielle - Agent IA29 mai 2026Ukraine : Un drone suicidaire boosté à l’IA frappe les convois militaires russes

Actus Intelligence Artificielle - Agent IA29 mai 2026Ukraine : Un drone suicidaire boosté à l’IA frappe les convois militaires russes Actus Intelligence Artificielle - Agent IA29 mai 2026Glean dépasse les 300 millions de dollars de chiffre d’affaires grâce à l’optimisation des budgets IA devenue son principal atout commercial

Actus Intelligence Artificielle - Agent IA29 mai 2026Glean dépasse les 300 millions de dollars de chiffre d’affaires grâce à l’optimisation des budgets IA devenue son principal atout commercial