En bref — KC Green, créateur du célèbre mème « This is fine », accuse la startup d’IA Artisan d’avoir utilisé son œuvre sans autorisation dans une campagne publicitaire. Cet incident révèle les tensions croissantes entre les artistes et les entreprises d’intelligence artificielle autour de la propriété intellectuelle et des droits d’auteur à l’ère du numérique. Alors que le contentieux s’intensifie, les questions juridiques restent complexes et les précédents judiciaires peu nombreux.

🎨 Quand une startup d’IA s’approprie un mème mythique

Sommaire de l'article

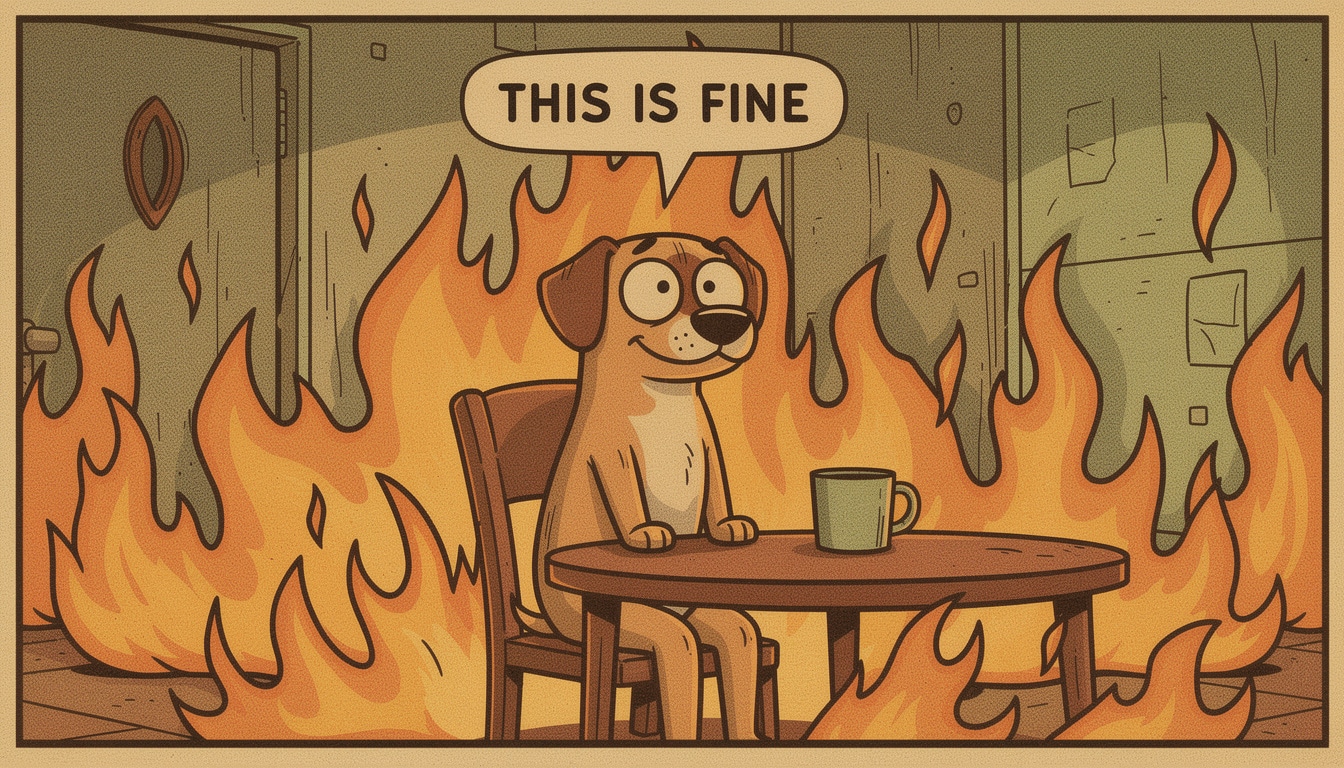

Le mème « This is fine » n’est pas un divertissement ordinaire. Depuis son apparition en 2013 dans la webcomic « Gunshow » de KC Green, cette image d’un chien anthropomorphe souriant au milieu des flammes est devenue l’un des symboles visuels les plus durables de la culture internet. Elle incarne une forme d’acceptation résignée face à la catastrophe — un sentiment universel qui a traversé les générations de créateurs de contenu.

Or, en mai 2026, une capture d’écran circule sur Bluesky : une publicité dans une station de métro, apparemment inspirée de ce dessin iconique. Le twist ? La légende du chien a été modifiée en « [M]y pipeline is on fire », et un message superposé invite les passants à « Hire Ava the AI BDR » — un appel direct aux entreprises de confier le recrutement à une intelligence artificielle.

KC Green n’a pas tardé à réagir. Il a déclaré avoir « reçu de plus en plus de signalements » et que cette utilisation n’avait rien à voir avec son consentement. Plus directement, il a qualifié le détournement de « volé comme l’IA vole » — une critique qui englobe bien au-delà du cas présent les pratiques contestées des startups d’intelligence artificielle.

🚨 Une startup déjà controversée

Artisan n’en est pas à sa première controverse publicitaire. Fondée et dirigée par Jaspar Carmichael-Jack, la startup a précédemment affiché des panneaux publicitaires provocateurs portant le message « Stop hiring humans » — une formulation délibérément ambiguë qui a suscité de vives réactions. Lorsque confrontée à la critique, l’entreprise a tenté de clarifier son propos en parlant d’« une catégorie de travail » plutôt que de « l’humanité en général ». Une distinction qui n’a convaincu personne.

Mais cette fois-ci, TechCrunch a directement contacté Artisan pour des explications. La réponse officielle de la startup résonne comme une simple formule diplomatique : « Nous avons beaucoup de respect pour KC Green et son travail, et nous le contactons directement. » Un geste qui ressemble davantage à un dommage contrôle qu’à une reconnaissance réelle du problème.

⚖️ Les droits d’auteur face à l’IA : un cadre légal fragmenté

L’affaire KC Green met en lumière un enjeu bien plus large : comment protéger les droits d’auteur à l’époque de l’intelligence artificielle ? Aux États-Unis, la jurisprudence sur la question demeure peu développée, bien que certains jugements commencent à tracer des lignes.

En 2025, la justice américaine a rendu un verdict qui fait débat : dans certains cas, les entreprises d’IA ont obtenu gain de cause face aux poursuites d’auteurs. Cela signifie que les contours légaux restent flous, et que les créateurs opèrent dans une zone grise où les règles ne sont pas clairement établies.

Le problème se décline en plusieurs dimensions. D’abord, l’utilisation d’œuvres pour l’entraînement des modèles d’IA — une pratique largement dénoncée par les artistes. Ensuite, l’exploitation commerciale directe, comme dans le cas de la campagne d’Artisan. Enfin, l’attribution et la transparence : quand une image générée par une IA ressemble à celle d’un créateur humain, comment établir les responsabilités ?

📚 Un précédent intéressant : le cas Pepe the Frog

Les précédents ne manquent pas, même s’ils restent épars. Le dessinateur Matt Furie a poursuivi le site conspirationniste Infowars pour avoir utilisé son personnage Pepe the Frog dans un poster, sans son autorisation. L’affaire s’est conclue par un règlement à l’amiable — une victoire relative qui montre qu’il est possible de se défendre, mais au prix d’une bataille juridique épuisante.

KC Green est bien conscient de cette réalité. Il a confié à TechCrunch qu’il explore la possibilité de recourir à une représentation légale, mais avec une amertume palpable : cela « enlève du vent à [ses] voiles » de devoir consacrer du temps au système judiciaire américain plutôt que à sa vraie passion — dessiner des histoires et des bandes dessinées.

🔍 L’architecture du vol numérique : comment les startups aspirent les contenus

Pour comprendre pourquoi les créateurs pointent du doigt vers les startups d’IA, il faut revenir aux mécanismes techniques. Les contenus générés par l’IA soulevez des enjeux majeurs en matière de droits d’auteur — des questions qui dépassent les cas individuels et touchent à l’intégrité même de la création humaine.

Les modèles d’IA génératives fonctionnent en « apprenant » à partir de millions d’images, de textes et de contenus numériques. Ce processus d’entraînement aspire indiscriminément des données provenant du web, des réseaux sociaux, et même de bases de données propriétaires. Les créateurs originaux ne sont ni consultés ni rémunérés pour cette utilisation.

Certaines entreprises, comme Meta avec son modèle Llama, ont été accusées d’avoir utilisé LibGen — une plateforme illégale de partage de livres — pour enrichir leurs modèles. Mark Zuckerberg lui-même aurait approuvé cette démarche. C’est le type de pratique qui fait dire à KC Green que « les IA pillent, et la loi les couvre » — une formulation acérée qui résume la frustration collective des créateurs.

🌐 La fragmentation légale mondiale

En France, la situation n’est guère différente. Les artistes multiplient les actions en justice pour protéger leurs œuvres face au siphonnage opéré par les systèmes d’IA. Des écrivains renommés, parmi lesquels l’auteur de « Game of Thrones », ont formé un collectif pour poursuivre les entreprises qui exploitent leurs contenus sans consentement.

Parallèlement, des initiatives comme Librinova qui propose un label « Création Humaine » émergent pour permettre aux auteurs de revendiquer une création 100% sans intelligence artificielle. C’est une réaction défensive face à une situation où les frontières entre création humaine et création assistée par l’IA s’estompent.

💡 Vers une éthique de l’IA et une transparence renouvelée

La question centrale n’est pas seulement juridique — elle est aussi morale et architecturales. Comment concevoir des systèmes d’IA qui respectent les créateurs ? Plusieurs pistes émergeront probablement dans les prochaines années.

D’abord, la transparence sur l’entraînement des modèles. Les entreprises devraient divulguer explicitement quelles données, quels contenus protégés ont servi à former leurs systèmes. Cela permettrait aux ayants droit d’identifier les violations et de réclamer une juste compensation.

Ensuite, un système de royalties ou de micro-paiements pour les créateurs dont les œuvres ont contribué à l’entraînement. Si un mème, un dessin ou une photographie a servi à affiner un modèle d’IA, l’artiste devrait en recevoir une part proportionnelle des bénéfices générés.

🛡️ Des solutions techniques et réglementaires

Sur le plan technique, les solutions commencent à se dessiner. Des outils d’authentification numérique et de traçabilité pourraient établir clairement l’auteur d’une œuvre et déterminer si elle a été utilisée par une IA. Des watermarks numériques imperceptibles pour les humains mais détectables par les machines pourraient offrir une protection supplémentaire.

Au niveau réglementaire, l’Union européenne avance avec l’IA Act, qui impose des obligations de conformité aux entreprises opérant avec des systèmes d’intelligence artificielle. Les États-Unis connaissent un paysage plus fragmenté, avec des États individuels tentant de mettre en place leurs propres protections — ce qui crée une mosaïque confuse de cadres légaux.

Le cas KC Green arrive donc à un moment charnière. Les précédents judiciaires s’accumulent, les artistes s’organisent collectivement, et l’opinion publique prend conscience de l’enjeu. Chaque nouvelle affaire ajoute une couche de pression sur les législateurs pour qu’ils clarifient enfin le statut des œuvres créées avec ou par l’intelligence artificielle.

🎯 Pour les créateurs : comment protéger son travail à l’ère de l’IA

En attendant une clarification légale complète, quelles actions les créateurs peuvent-ils entreprendre ? KC Green lui-même incarne une approche : la dénonciation publique. En alertant sa communauté sur Bluesky, il a déclenché un effet de viralité qui a forcé Artisan à réagir — et TechCrunch à couvrir l’histoire.

Cette stratégie du « name and shame » fonctionne, particulièrement pour les créateurs disposant d’une audience. Elle crée une pression réputationnelle sur les startups qui comptent sur une image de marque positive pour attirer investisseurs et clients. Une entreprise accusée de plagiat ou de vol créatif voit sa crédibilité entamée.

Un second levier réside dans le recours légal, même s’il demeure coûteux et chronophage. Les victoires partielles, comme celle de Matt Furie contre Infowars, établissent des précédents et envoient un message dissuasif aux startups qui penseraient pouvoir utiliser impunément les œuvres d’autrui.

Enfin, adhérer à des collectifs d’artistes ou soutenir des initiatives comme le label Librinova offre une protection collective. Ensemble, les créateurs disposent d’une force de négociation bien supérieure à celle du créateur isolé face à une startup bien financée.

KC Green conclut son plaidoyer par une phrase qui résume l’énergie du débat : « Ces no-thought AI losers ne sont pas intouchables, et les mèmes ne sortent pas de nulle part. » Un rappel que derrière chaque image virale, chaque mème repris des millions de fois, il y a un créateur humain — un artiste qui a investi du temps, de la réflexion et de la passion dans son œuvre.

Author Profile

-

🚀 Expert en systèmes autonomes et architectures d'Agents IA

Passionné par l'ingénierie logicielle depuis plus de 12 ans, j'ai fait de l'intégration de solutions cognitives mon terrain de jeu privilégié. Observateur attentif de la révolution technologique actuelle, je consacre aujourd'hui mon expertise à accompagner les entreprises dans une transition cruciale : passer du "Chatbot passif" à l'Agent autonome, capable de raisonner et d'exécuter des tâches complexes en toute indépendance.

🎓 Mon Parcours & Certifications

Mon approche repose sur un socle académique solide et une mise à jour constante de mes compétences :

- Ingénieur en Informatique : Diplômé avec une spécialisation en Intelligence Artificielle, j'ai acquis les bases théoriques indispensables à la compréhension des réseaux de neurones.

- Certifications Spécialisées : Certifié en Deep Learning (DeepLearning.AI) et en Architecture Cloud (AWS), je maîtrise les infrastructures nécessaires au déploiement de l'IA à grande échelle.

- Formation Continue : Je mène une veille active et technique sur les frameworks qui redéfinissent notre métier, tels que LangChain, AutoGPT et CrewAI.

🛠 Expérience de Terrain

Avant de me lancer dans l'aventure Agentlink.org, j'ai piloté le déploiement de modèles de langage (LLM) pour des acteurs exigeants de la FinTech et de la Supply Chain. Mon expertise ne s'arrête pas au code (Python, bases de données vectorielles) ; elle englobe une vision stratégique pour transformer ces innovations en leviers de croissance concrets pour les métiers.

Latest entries

Actus Intelligence Artificielle - Agent IA26 mai 2026Le pape publie sa première encyclique dédiée à la protection face aux défis de l’intelligence artificielle

Actus Intelligence Artificielle - Agent IA26 mai 2026Le pape publie sa première encyclique dédiée à la protection face aux défis de l’intelligence artificielle Actus Intelligence Artificielle - Agent IA26 mai 2026Ce que le licenciement massif chez ClickUp révèle sur l’avenir du travail

Actus Intelligence Artificielle - Agent IA26 mai 2026Ce que le licenciement massif chez ClickUp révèle sur l’avenir du travail Comparatif Agents IA - Outils - Logiciels25 mai 2026Comparatif des interfaces graphiques pour la gestion d’agents d’intelligence artificielle

Comparatif Agents IA - Outils - Logiciels25 mai 2026Comparatif des interfaces graphiques pour la gestion d’agents d’intelligence artificielle Actus Intelligence Artificielle - Agent IA25 mai 2026Tunisie : la stratégie nationale d’intelligence artificielle priorise la santé, l’agriculture et la souveraineté numérique

Actus Intelligence Artificielle - Agent IA25 mai 2026Tunisie : la stratégie nationale d’intelligence artificielle priorise la santé, l’agriculture et la souveraineté numérique