En bref : Il y a soixante ans, Joseph Weizenbaum créait Eliza au MIT, le tout premier agent conversationnel de l’histoire. Ce programme rudimentaire, capable uniquement de détecter des mots-clés et de reformuler les phrases en questions, a pourtant démontré une capacité remarquable à captiver ses utilisateurs. L’anecdote d’une secrétaire demandant à rester seule avec la machine pour poursuivre sa « thérapie » révèle bien la puissance d’une illusion : celle de croire qu’une machine nous comprend. Ce phénomène, appelé « effet Eliza », reste au cœur de notre rapport aux chatbots modernes et pose des questions éthiques majeures sur l’anthropomorphisme et l’intimité entre l’homme et la machine.

Brief : 🤖 Eliza, créée en 1964-1966, simule un psychothérapeute rogérien en utilisant des règles de détection de mots-clés — une technique aujourd’hui primitive mais révolutionnaire. 💬 L’« effet Eliza » décrit la tendance humaine à projeter de l’intelligence et de l’empathie sur des machines qui n’en possèdent pas. 🔍 Des chercheurs ont retrouvé le code source perdu d’Eliza et l’ont remis en service en 2026. 📈 Soixante ans plus tard, l’illusion n’a fait que s’amplifier avec les LLM et ChatGPT. ⚠️ Experts et associations tirent la sonnette d’alarme sur les risques psychologiques, notamment chez les jeunes.

🎬 Quand Eliza a révolutionné l’interaction homme-machine : retour aux origines du premier chatbot

Sommaire de l'article

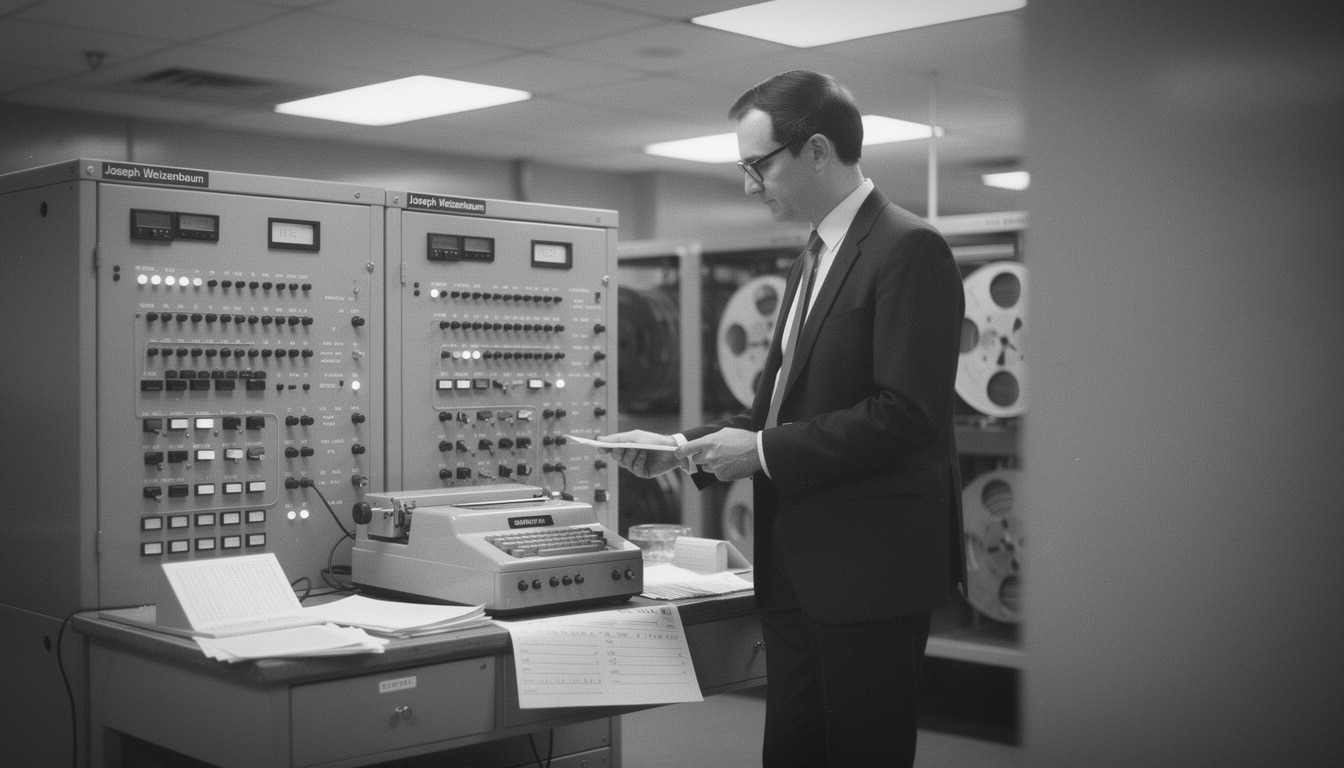

Aux débuts des années 1960, l’informatique n’était encore qu’une curiosité réservée aux laboratoires universitaires. Dans son labo du MIT, près de Boston, Joseph Weizenbaum, un informaticien germano-américain passionné, s’attelle à une mission ambitieuse : créer le premier dialogue authentique entre un humain et une machine. Entre 1964 et 1966, il conçoit Eliza, un programme informatique capable de converser avec ses utilisateurs en simulant un psychothérapeute.

Le fonctionnement d’Eliza repose sur un principe étonnamment simple : identifier des motifs et des mots-clés dans les phrases de l’interlocuteur, puis les reformuler en questions pour encourager la poursuite du dialogue. Pas de compréhension sémantique, pas d’analyse émotionnelle, pas même de vraie réflexion — juste une architecture logique capable de créer l’illusion d’une écoute attentive.

Le script le plus célèbre s’intitule « DOCTOR », inspiré par les travaux du psychologue américain Carl Rogers. Sa méthode reposait sur l’écoute active et l’empathie non-directive : encourager le patient à explorer ses propres pensées en rebondissant sur ses paroles. À l’affirmation « Je ne suis pas heureux », Eliza répondait simplement : « Pouvez-vous m’expliquer ce qui ne vous rend pas heureux ? » — une technique basique mais redoutablement efficace pour maintenir l’interaction.

🎭 Le nom d’Eliza : un hommage à la pièce de théâtre Pygmalion

Joseph Weizenbaum ne choisit jamais rien au hasard. En nommant son programme « Eliza », il rend hommage au personnage d’Eliza Doolittle, l’héroïne de la pièce de théâtre Pygmalion écrite en 1912 par le dramaturge irlandais George Bernard Shaw. Fleuriste parlant l’argot des bas quartiers de Londres, Eliza Doolittle suit des cours pour apprendre à s’exprimer comme les gens de la haute société, au point de pouvoir se faire passer pour une duchesse.

« À l’instar de son homonyme littéraire, Eliza peut améliorer ses capacités linguistiques grâce à un professeur », explique Weizenbaum dans l’article de présentation de son programme. Cependant, Shaw révèle dans sa pièce une vérité troublante : apprendre un langage raffiné ne suffit pas à transformer véritablement quelqu’un. L’apparence peut tromper, mais la réalité reste différente.

Weizenbaum applique cette même philosophie à son programme : « Tout comme l’Eliza de Pygmalion, on peut la faire paraître encore plus civilisée, mais le rapport entre l’apparence et la réalité reste du ressort du dramaturge. » Bien qu’elle puisse donner l’impression de comprendre, l’Eliza informatique ne possède aucune véritable conscience ou intelligence. La conversation demeure une chimère — mais c’est précisément là que réside toute la puissance de son invention.

💡 L’effet Eliza : comment une machine simple a trompé les humains

L’anecdote la plus frappante de l’expérience Eliza date de ses premiers tests. Une secrétaire du laboratoire, après avoir discuté avec le programme, a demandé à Joseph Weizenbaum de quitter la pièce pour pouvoir continuer sa conversation en privé. Elle voulait parler seule avec la machine — comme si elle confiait ses secrets à un véritable thérapeute.

Weizenbaum lui-même avait du mal à convaincre certains utilisateurs qu’Eliza n’était pas dotée de vraies capacités humaines comme l’empathie ou l’analyse psychologique. Même en sachant techniquement que c’était un simple programme informatique, les sujets se mettaient à partager des informations sensibles et profondes, comme s’ils entretenaient une conversation authentique avec un interlocuteur bienveillant et attentif.

Ce phénomène ne s’appelle pas « effet Eliza » par hasard. Il décrit cette tendance psychologique à attribuer plus de sens qu’il n’en a réellement aux interactions avec les machines, et à projeter inconsciemment des qualités humaines à des ordinateurs qui en sont totalement dépourvus. Malgré un comportement purement superficiel, l’utilisateur « croit » que le programme le « comprend ».

🪞 Un miroir de nos besoins humains

Justine Cassell, directrice de recherches à l’Inria et affiliée à l’université Carnegie Mellon, offre une analyse nuancée de ce phénomène : « On attribue ce dont on a besoin aux agents conversationnels, mais on le fait aussi avec une peluche, sa voiture, un animal ou un bébé qui ne nous comprennent pas. C’est une qualité humaine en jeu : notre besoin profond d’être écouté. »

Contrairement à une peluche ou à une voiture, les agents conversationnels démontrent activement qu’ils nous écoutent. Ils reformulent nos paroles, posent des questions de suivi, maintiennent le fil de la conversation. Ce comportement miroir satisfait un besoin fondamental : être entendu, considéré, reconnu. C’est pourquoi l’anthropomorphisme n’est pas une faiblesse de la cognition humaine, mais plutôt une expression de notre structure psychologique.

🚀 Six décennies d’évolution : d’Eliza aux LLM et ChatGPT

Soixante ans après sa création, la promesse d’Eliza s’est transformée de façon spectaculaire. Si le programme original ne pouvait que détecter des mots-clés et reformuler des questions, les agents conversationnels modernes reposent sur des architectures entièrement différentes : les Large Language Models (LLM).

Avec ChatGPT et ses homologues, l’illusion est devenue infiniment plus raffinée. Ces modèles génèrent des réponses complexes et nuancées, souvent impossible à distinguer d’une réaction humaine. Ils adaptent leur ton, reconnaissent le contexte, établissent des raisonnements multi-étapes. Un data scientist chez Meta résume élégamment cette évolution : « Le programme est conçu pour vous faire croire que vous parlez à quelqu’un qui n’est pas réellement là. »

Paradoxalement, l’effet Eliza n’a pas diminué — il s’est amplifié. Plus la technologie devient sophistiquée, plus l’illusion devient convaincante, et plus les utilisateurs sont susceptibles de développer une relation d’intimité avec ces systèmes. Des associations et des experts tirent la sonnette d’alarme, particulièrement face à l’usage de thérapeutes virtuels chez les jeunes.

📊 Ce que les données nous révèlent sur les risques actuels

Un rapport du CNRS publié en 2024 soulève des préoccupations sérieuses : les utilisateurs d’agents conversationnels avancés développent l’illusion qu’un lien intime et de confiance se noue avec la machine. Cette relation peut devenir problématique lorsqu’elle remplace l’interaction humaine ou lorsque l’utilisateur en vient à s’y attacher émotionnellement.

Joseph Weizenbaum lui-même, peu de temps après le succès d’Eliza, s’est mis à alerter publiquement sur les dangers de l’intelligence artificielle et des usages qui pouvaient en être faits. Cette prise de conscience a conduit le scientifique à prendre ses distances avec la communauté académique et technologique, au point de sombrer dans une certaine forme d’oubli. Son message était prophétique : les machines peuvent simuler l’empathie, mais cette simulation peut causer du tort.

🔍 La résurrection d’Eliza : quand les archéologues numériques ramènent l’histoire à la vie

En 2026, des chercheurs ont accompli un exploit remarquable : retrouver le code source perdu d’Eliza dans les archives poussiéreuses du MIT et la remettre en service. Pendant près de soixante ans, ce code s’était évaporé des serveurs informatiques, préservé uniquement dans de vieux documents imprimés.

La redécouverte d’Eliza n’est pas qu’une curiosité nostalgique. Elle offre aux développeurs et aux chercheurs actuels la possibilité de revisiter les origines des agents conversationnels et de comprendre comment une architecture aussi primitive pouvait déclencher de telles illusions psychologiques. C’est une leçon d’humilité technologique : les vraies révolutions en IA ne se mesurent pas toujours en termes de complexité brute.

⚡ Les leçons intemporelles d’Eliza pour les systèmes IA actuels

Que pouvons-nous tirer de cette résurrection numérique ? D’abord, l’importance de la transparence. Les utilisateurs doivent savoir qu’ils interagissent avec une machine, pas avec un être conscient capable d’empathie authentique. Weizenbaum avait déjà identifié ce problème : la confusion entre apparence et réalité.

Deuxièmement, la nécessité d’une régulation éthique. Si une machine aussi simple qu’Eliza pouvait déclencher une dépendance affective, que dire des LLM dotés de millions de paramètres et capables de générer du contenu quasi-indistinguishable du contenu humain ? Les professionnels et les décideurs doivent intégrer cette réalité dans leurs stratégies de déploiement.

Enfin, il est crucial de maintenir une distinction claire entre simulation de compréhension et compréhension véritable. Un agent conversationnel, aussi avancé soit-il, reste une construction probabiliste produisant des tokens basés sur des patterns statistiques. Ce qu’il « dit » n’émerge pas d’une réflexion interne authentique.

🎯 Le test du miroir : reconnaître ce que nous voyons vraiment dans les machines

Un concept récent émerge dans la discussion critique sur les chatbots modernes : le « test du miroir de l’IA », popularisé par le journaliste James Vincent du Verge. Contrairement au célébrissime test de Turing, qui cherche à déterminer si une machine « pense » vraiment, le test du miroir reconnaît une vérité simple : ce que nous voyons dans les chatbots, c’est essentiellement nous-mêmes, pas une nouvelle forme de vie.

Nous y projetons nos attentes, nos besoins, nos espoirs. Nous humanisons ce qui ne l’est pas. Cette prise de conscience n’est pas déprimante — c’est libératrice. Elle nous ramène à la responsabilité humaine : celle de concevoir des systèmes IA avec intégrité, et celle d’utiliser ces outils sans sacrifier notre jugement critique.

L’héritage véritable d’Eliza ne réside pas dans sa capacité à simuler une thérapie, mais dans la réflexion qu’elle a engendrée sur le dialogue et la nature de nos relations avec les machines. Soixante ans après, cette réflexion est plus pertinente que jamais. À mesure que les agents autonomes se déploient dans les entreprises et la vie quotidienne, comprendre l’effet Eliza devient un enjeu stratégique et éthique.

🌍 Pourquoi comprendre l’histoire d’Eliza reste crucial pour l’avenir de l’IA

En 2026, nous baignons dans un écosystème d’agents conversationnels : assistants vocaux, chatbots de service client, compagnons virtuels, tuteurs éducatifs. Chaque plateforme offre des variantes sophistiquées des principes que Weizenbaum avait établis six décennies plus tôt.

Pourtant, bon nombre de développeurs et de décideurs ignorent cette histoire. Ils conçoivent des systèmes sans comprendre les pièges psychologiques que leurs créateurs devraient éviter. Résultat : des chatbots deviennent des substituts à la thérapie humaine, créant des relations de dépendance malsaines. Des utilisateurs demandent à leurs assistants vocaux de rester par leur côté, exactement comme la secrétaire du MIT l’a fait avec Eliza.

L’histoire de Weizenbaum est un avertissement, pas une condamnation de la technologie. Il ne s’agit pas de rejeter les agents conversationnels, mais de les concevoir et de les utiliser en toute connaissance de cause. Cela signifie reconnaître à la fois leurs capacités réelles et leurs limites fondamentales.

🔮 Vers une IA plus consciente de ses propres frontières

Les meilleures équipes d’IA aujourd’hui intègrent la philosophie weizenbaummienne dans leur conception. Elles construisent des systèmes qui sont honnêtes quant à leurs limitations, qui refusent de prétendre à une compréhension qu’elles ne possèdent pas, et qui maintiennent la responsabilité humaine au centre du processus décisionnel.

Des organisations progressistes reconnaissent que l’IA doit servir les humains, pas remplacer la connexion humaine. Des régulations émergeant autour de la transparence des IA et des risques sanitaires reflètent cette prise de conscience croissante.

La leçon finale d’Eliza ? L’intelligence artificielle n’est jamais neutre. Elle cristallise les choix, les biais, et les intentions de ses créateurs. Soixante ans après, nous avons l’opportunité de concevoir des systèmes qui amplifient notre intelligence plutôt que de nous tromper sur la nature de ce qui se passe réellement dans ces boîtes noires en silicium.

Author Profile

-

🚀 Expert en systèmes autonomes et architectures d'Agents IA

Passionné par l'ingénierie logicielle depuis plus de 12 ans, j'ai fait de l'intégration de solutions cognitives mon terrain de jeu privilégié. Observateur attentif de la révolution technologique actuelle, je consacre aujourd'hui mon expertise à accompagner les entreprises dans une transition cruciale : passer du "Chatbot passif" à l'Agent autonome, capable de raisonner et d'exécuter des tâches complexes en toute indépendance.

🎓 Mon Parcours & Certifications

Mon approche repose sur un socle académique solide et une mise à jour constante de mes compétences :

- Ingénieur en Informatique : Diplômé avec une spécialisation en Intelligence Artificielle, j'ai acquis les bases théoriques indispensables à la compréhension des réseaux de neurones.

- Certifications Spécialisées : Certifié en Deep Learning (DeepLearning.AI) et en Architecture Cloud (AWS), je maîtrise les infrastructures nécessaires au déploiement de l'IA à grande échelle.

- Formation Continue : Je mène une veille active et technique sur les frameworks qui redéfinissent notre métier, tels que LangChain, AutoGPT et CrewAI.

🛠 Expérience de Terrain

Avant de me lancer dans l'aventure Agentlink.org, j'ai piloté le déploiement de modèles de langage (LLM) pour des acteurs exigeants de la FinTech et de la Supply Chain. Mon expertise ne s'arrête pas au code (Python, bases de données vectorielles) ; elle englobe une vision stratégique pour transformer ces innovations en leviers de croissance concrets pour les métiers.

Latest entries

Actus Intelligence Artificielle - Agent IA29 avril 2026Un réseau de neurones révolutionnaire élucide enfin les mystères du comportement des plasmas

Actus Intelligence Artificielle - Agent IA29 avril 2026Un réseau de neurones révolutionnaire élucide enfin les mystères du comportement des plasmas Actus Intelligence Artificielle - Agent IA29 avril 2026Lors de son procès contre OpenAI, Musk revisite une vieille amitié

Actus Intelligence Artificielle - Agent IA29 avril 2026Lors de son procès contre OpenAI, Musk revisite une vieille amitié Actus Intelligence Artificielle - Agent IA28 avril 2026Fin du partenariat exclusif Microsoft-OpenAI : OpenAI ouvre la voie à de nouveaux partenariats pour son IA

Actus Intelligence Artificielle - Agent IA28 avril 2026Fin du partenariat exclusif Microsoft-OpenAI : OpenAI ouvre la voie à de nouveaux partenariats pour son IA Actus Intelligence Artificielle - Agent IA28 avril 2026OpenAI met fin aux risques juridiques de Microsoft liés à son accord de 50 milliards de dollars avec Amazon

Actus Intelligence Artificielle - Agent IA28 avril 2026OpenAI met fin aux risques juridiques de Microsoft liés à son accord de 50 milliards de dollars avec Amazon